OpenAI 正在系統性地、有預謀完成了從「為人類謀福祉」到「為投資者謀利潤」的根本性轉變,CEO 奧特曼存在長期、有據可查的言行不一、操縱資訊和規避監督的行為模式,且個人投資與公司業務的深度捆綁。

(前情提要:GPT-5 今夏登場!Sam Altman 親揭 OpenAI 下一代模型藍圖、Stargate 星際之門野心、會有廣告嗎? )

(背景補充:OpenAI 震撼彈!併購蘋果傳奇設計師 Jony Ive 公司 io,Altman:「最夢幻 AI 硬體」正在路上 )

一個超過 50 頁,逾萬字的互動式報告,揭露了 OpenAI 從非營利研究實驗室演變為營利巨頭的全過程。近期,由兩大非營利科技監督組織 ——Midas Project 與 Tech Oversight Project—— 聯合釋出了一份名為《OpenAI 檔案》的深度調查報告。

該報告由 Midas Project 執行董事 Tyler Johnston 主導,歷時近一年的公開資訊收集與一個月的集中撰寫。報告被稱為「迄今為止,針對 OpenAI 在公司治理實踐、領導層誠信及組織文化方面,已記錄在案的擔憂的最全面彙編」。

通過梳理公司披露檔案、法律訴訟、公開信及媒體報導等大量公開資料,這份超過一萬字的互動式報告發現,OpenAI 正在系統性地、有預謀完成了從「為人類謀福祉」到「為投資者謀利潤」的根本性轉變,CEO 奧特曼存在長期、有據可查的言行不一、操縱資訊和規避監督的行為模式,且個人投資與公司業務的深度捆綁。OpenAI 在安全和透明度方面言行不一,其公開承諾與內部實踐嚴重脫節。

報告分為四大主題,一是重組、二是執行長誠信、三是透明度和安全性、四是利益衝突。

其中,OpenAI 高管和董事會成員從公司成功中直接或間接獲益的程度令人關注。其中包括對 CEO 奧特曼投資組合的分析,涉及 Retro Biosciences、Helion Energy、Reddit、Stripe 等多家與 OpenAI 存在合作關係的公司。

重組:一場精心策劃的「使命背叛」

報告指出,OpenAI 正在系統性地、有預謀地拆除其創立時的核心道德與結構支柱,其行為與公開宣告存在嚴重矛盾,本質上是一場從「為人類謀福祉」到「為投資者謀利潤」的根本性轉變。

首先,報告揭示了 OpenAI 兩大核心支柱 ——「利潤上限」與「非營利監督」—— 的同步瓦解。

最初的「利潤上限」(Capped-Profit)模式是其核心哲學,意在確保 AGI 創造的巨大財富能與全人類共享,防止財富過度集中。然而,這一承諾被逐步掏空:從表面上看似加強使命的利潤倍數下調,到祕密引入「每年自動增長 20%」這一使其在功能上形同虛設的條款,再到最終計劃完全移除上限,標誌著財富共享理念的徹底終結。

與此同時,其監督機制也被巧妙地削弱。OpenAI 從一個由非營利組織完全控制的實體,轉型為特拉華州的公益公司。法律義務從「使命優先」變成「平衡股東利益和公共利益」。報告指出,歷史上「沒有股東成功起訴以保護公共利益的先例」,這使得公益承諾在法律實踐中幾乎無法執行。這表明,PBC 的「公益」承諾在現實中可能淪為空殼,為追求利潤最大化提供了巨大的法律掩護。

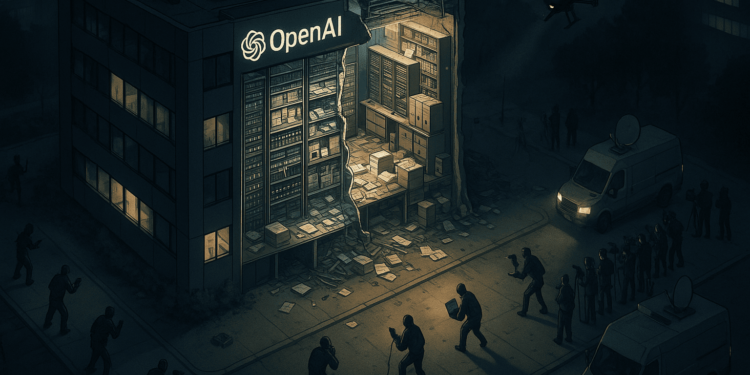

圖片來源:openaifiles.org/ 網站

報告進一步駁斥了 OpenAI 以「行業競爭激烈」為由放棄承諾的官方說辭。通過引用公司早期的《章程》和內部郵件,報告證明 OpenAI 在創立之初就已充分預料並準備應對激烈的行業競爭。因此,用競爭作為背棄承諾的理由,是一種站不住腳的「修正主義歷史」。這背後真正的動機,恰恰是投資者和公司高層都相信其巨大的盈利潛力,因此移除上限才變得至關重要。

CEO 誠信:CEO 行為模式引發信任危機

報告進一步指出,CEO 奧特曼存在長期、有據可查的言行不一、操縱資訊和規避監督的行為模式,以及將個人利益置於組織責任之上。

報告列舉了多個奧特曼在重大問題上公開撒謊或誤導的例項。例如:

在員工非貶低協議問題上,Altman 公開聲稱不知情「剝奪離職員工股權」條款,但檔案顯示他明確授權了此條款。

在參議院宣誓作證時,他聲稱沒有 OpenAI 股權,但後來承認曾通過基金間接持有。

長期向董事會隱瞞其個人擁有 OpenAI 創業基金的事實。

前董事會成員 Helen Toner 直接指控 Altman 通過「隱瞞資訊、歪曲事實、甚至直接撒謊」來阻礙董事會履職。報告還顯示,這種行為模式貫穿其職業生涯:

在 Loopt 時期,資深員工曾兩次試圖讓董事會解僱他,理由是「欺騙性和混亂的」行為。

在 Y Combinator 期間,他因專注個人專案而玩忽職守,最終被創辦人 Paul Graham「請走」。

最戲劇性的體現是,在被 OpenAI 董事會解僱後,他利用影響力反向操作,以「罷免開除他的董事會成員並安插自己盟友」作為迴歸條件,成功實現對監督體系的「反噬」。

運營與安全風險:安全承諾的系統性落空

報告揭示,OpenAI 在安全和透明度方面存在一種系統性的言行不一,其公開承諾與內部實踐嚴重脫節。公司文化表現出一種「唯快不破」的傾向,為了追求商業利益和競爭優勢,正在系統性地削弱、規避甚至懲罰內部的安全監督和異議。

報告揭示了 OpenAI 在安全和透明度方面的系統性言行不一。公司曾承諾將 20% 的計算資源投入「超級對齊」安全團隊,但據前負責人 Jan Leike 透露,這筆資源從未被分配。在 GPT-4o 開發中,安全團隊被要求在產品釋出前「快速完成」測試,公司甚至在評估開始前就已計劃好釋出慶祝活動。

更嚴重的是,公司使用嚴苛的離職協議威脅離職員工,若批評公司將損失數百萬美元股權。員工 Leopold Aschenbrenner 因向董事會提交國家安全風險備忘錄而被解僱,公司明確告知解僱原因正是他「越級」報告安全問題。

報告還指出,OpenAI 在 2023 年發生駭客入侵、AI 技術細節被盜的嚴重安全事件,但在長達一年時間裡未向當局或公眾報告。多名現任和前任員工指控公司存在「魯莽和保密的文化」,將「利潤和增長」置於安全使命之上。

利益衝突風險:CEO 個人投資與公司業務的深度捆綁

報告詳盡地揭示了奧特曼如何建立了一個龐大且相互交織的個人投資網路,這些投資與 OpenAI 的業務、技術和戰略伙伴關係存在深刻且直接的利益衝突,從根本上挑戰了 OpenAI 所宣稱的「為全人類謀福祉」的使命。

以下是幾個典型案例:

Helion(核聚變能源):奧特曼既是 Helion 的董事長和主要投資者,又是 OpenAI 的 CEO。他親自主導了 OpenAI 從 Helion 購買大量能源的交易。令人有理由質疑這筆交易是否主要為了保障他個人在 Helion 的鉅額投資。

Worldcoin(加密貨幣專案):奧特曼是 Worldcoin 的共同創辦人。OpenAI 與 Worldcoin 建立了官方合作關係(如提供免費 GPT-4 服務)。人們質疑這究竟是平等的商業合作,還是奧特曼在利用 OpenAI 的資源和品牌,來扶持和推廣他自己的另一個高風險專案。

Humane(AI 硬體):奧特曼是 Humane 的最大股東,而 Humane 的產品嚴重依賴 OpenAI 的模型。作為 OpenAI 的 CEO,他有強烈的個人財務動因去確保 Humane 獲得優惠條款或優先技術支援,這可能損害其他客戶的利益和市場的公平性。

這些盤根錯節的利益關係,嚴重侵蝕了奧特曼作為 CEO 的信託責任。他的決策到底是為了 OpenAI 的使命,還是為了他個人的財富增長?報告最終描繪的圖景是:奧特曼更像一個精明的資本操盤手,他巧妙地將 OpenAI 置於其個人商業帝國的中心,並利用其 CEO 的職位,系統性地將 OpenAI 的技術、資源和戰略關係,轉化為個人投資組合的增長動力。

📍相關報導📍

OpenAI新推工程師代理人Codex!AI可寫功能、修Bug、跑測試..限3種用戶搶先用