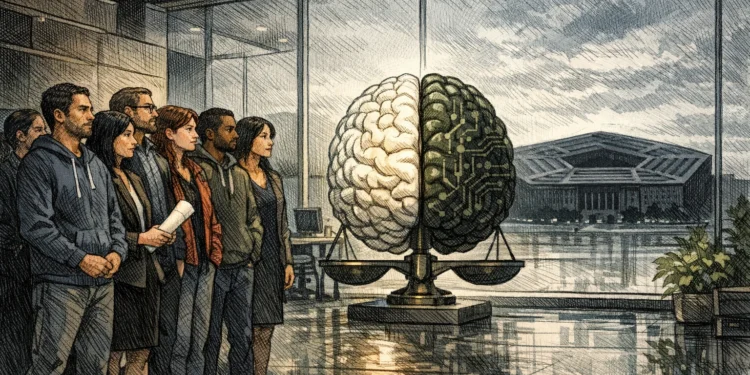

逾 600 名 Google 員工(含 20 名以上副總裁與高階主管)聯名致函 CEO Sundar Pichai,要求公司拒絕將 Gemini 擴充至五角大廈機密網路的新協議。員工指出,機密環境中任何外部實體均無法控制 AI 系統,現有保障措施在技術上無法執行。

(前情提要:Y Combinator 創業指南解讀:AI Agent 在未來有哪些發展趨勢?)

(背景補充:加州大學研究「AI 腦霧」現象:14% 上班族被Agent、自動化搞瘋,離職意願高四成)

600 名 Google 員工聯名致函 CEO Sundar Pichai,簽署者包含 DeepMind 資深研究員、超過 20 名副總裁與高階主管,要求公司不要授權 Gemini 進入五角大廈機密軍事網路。

從非機密到機密

讓我們先整理一下雙方的合作。2022 年底,Google 與 AWS、微軟、Oracle 共同拿下美國國防部一項核心雲端採購計畫 JWCC,總規模上限 90 億美元。

2025 年 12 月,基於 Gemini 的 GenAI.mil 平台正式上線,用於非機密環境。

到了 2026 年 3 月,Gemini AI agent 已部署給國防部全體 300 萬名人員使用。

以上這些都還是非機密端的應用。

但現在談判中的新協議,要將 Gemini 的功能擴充到「機密」環境:也就是與外部網路物理隔絕的 air-gapped 封閉網路,專門用於機密軍事作業。簡單來說:Gemini 將進入的是作戰指揮中心。

談判桌上的分歧很清楚。Google 試圖在合約中劃出紅線:禁止 Gemini 被用於追蹤本國公民、或在缺乏人為介入的情況下執行打擊決策。但五角大廈的立場是「所有合法用途」,這四個字不留任何明確禁區,並明確規定外部廠商不得對其 AI 系統保有任何控制權。

兩個條件直接衝突。Google 員工在聯名信中指出,公司提出的保障措施「就技術而言無法執行」。

機密環境的結構性困境

聯名信發起人點出一個根本問題:「機密工作就定義而言,就是不透明的。」這句話的意思是,一旦 Gemini 進入機密網路,Google 自己也看不到它在做什麼。

在非機密環境,Google 可以審計 API 呼叫、監控模型輸出、設定防護欄,在發現問題時介入。在機密環境,這些都不存在。

員工在信中列舉具體疑慮:對個人的剖繪分析(profiling,即用 AI 建立目標人物的行為與身份模型)、將無辜平民作為打擊目標。這些應用場景並非假設,而是 AI 輔助軍事行動的既有模式。

現任 Google 管理層面臨的困境在於:它在技術上無法向員工保證 Gemini 不會被用於特定用途,因為它根本無法進入那個網路驗證。

Google AI 原則的靜默消失,與 Maven 的歷史對照

2025 年 2 月,Google 悄悄修改了 AI 使用原則,移除了明確禁止「開發武器或監控 AI」的條款。DeepMind CEO Demis Hassabis 給出的理由是全球 AI 領導權競爭正在展開,人權觀察與國際特赦組織隨即公開譴責這次修改。

2018 年的 Maven 案,4,000 名員工聯署、至少 12 人辭職,最終迫使 Google 宣布不續約,合約由 Palantir 接手。

Maven 案的成功,部分原因是 2018 年 AI 軍事應用尚屬邊緣議題,Google 的品牌代價高於合約價值。八年後,AI 已是國防基礎設施的核心競爭專案,Google 與 AWS、微軟正在全面搶單。

市場地位、政治壓力、競爭格局,都指向同一個方向:一封信似乎還不足以對抗龐大合約背後的市場利益。

📍相關報導📍

加州大學研究「AI 腦霧」現象:14% 上班族被Agent、自動化搞瘋,離職意願高四成

Y Combinator 創業指南解讀:AI Agent 在未來有哪些發展趨勢?

灰度報告:為什麼加密貨幣能幫助 AI 人工智慧走上對的道路?