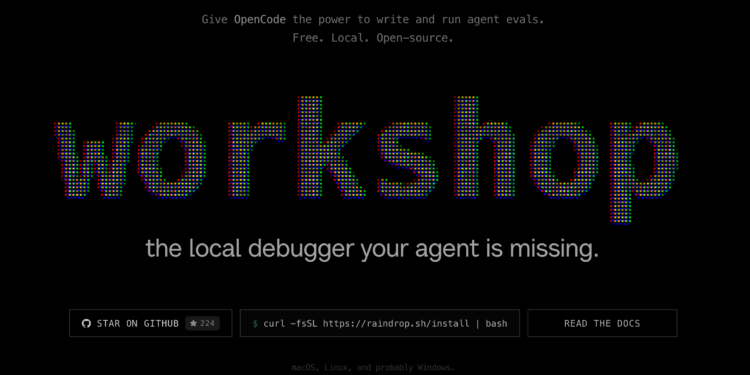

AI Agent 開發者工具公司 Raindrop 本週開源本地調試器 Workshop(v0.1.6),讓開發者可即時追蹤 Agent 每個 token 輸出和工具呼叫,並透過 MCP 讓 Claude Code 自動讀取、撰寫測試與修復。

(前情提要:Claude 寫程式瘋狂犯錯裝傻?改造 Andrej Karpathy 的12 條規則幫你把錯誤率從 41% 砍到 3%)

(背景補充:Anthropic 推出「Claude for Small Business」:瞄準中小企業 AI 自動化工作)

你的 AI Agent 剛跑出一個奇怪的結果。它選了一個你沒有預期的工具,輸出了一段語義含糊的回應。你開啟日誌,看到的是一堆 API 呼叫和 token 數字,但沒有任何線索告訴你哪個決策走錯了。

Raindrop 在 5 月 14 日發布了一個開源工具,試圖讓這個場景不再發生:一個完全本地端、完全免費的 AI Agent 偵錯程式 Workshop。讓開發者可以即時追蹤 Agent 每一個 token 輸出和工具呼叫,然後把除錯這件事本身,交給 Claude Code 或 Codex 來做。

AI Agent 的除錯問題為什麼特別難?

傳統軟體除錯有斷點、有完整的呼叫堆疊、有確定性的執行路徑。AI Agent 的除錯不一樣。它的行為是機率性的,同樣的輸入在不同執行下可能走出完全不同的路;它的決策是在多層 LLM 呼叫之間分散形成的,單靠終端輸出幾乎看不出任何邏輯。

問題的本質是:你不是在找「哪一行程式碼寫錯了」,而是在找「Agent 在某個特定的上下文組合下做出了一個非預期的判斷,是在哪一步出了問題」。這種問題,靠傳統 debugger 是找不到答案的。

現有解法通常只有兩條路:

- 一是雲端監控平台,把 trace 送到第三方服務用儀錶板分析

- 二是在程式碼裡塞滿自定義 logging 邏輯

前者對有資料隱私顧慮的開發者不友善,後者費時費力,每次框架升級都要維護一套新的 logging 基礎設施。而且兩者都有一個共同問題:它們告訴你「發生了什麼」,但不幫你「修好它」。

Workshop 選擇了第三條路:完全本地端執行,不傳送任何資料到外部伺服器,開源,免費,讓 AI 直接參與除錯迴圈。

Workshop 的工作方式

啟動後,Workshop 在本地執行一個視覺化介面,並對外暴露一個 MCP(Model Context Protocol)Server。MCP 翻譯過來就是「讓 AI 工具能夠呼叫外部能力的標準通訊協定」——它是 Claude Code 等 AI 編碼工具讀取外部資料的橋梁。

一旦接入支援的 SDK,Agent 的每個執行節點 — 每個 token 輸出、每個工具呼叫、每個決策分支 — 都以串流方式即時出現在 localhost:5899,不需要 polling,不需要手動重整。

用直白的話說,就是在你的電腦本地開一個監控視窗,讓你像看直播一樣,即時看到 AI Agent 在做什麼。

Workshop 最關鍵的設計,是把 Claude Code 等設計助手引進除錯迴圈。由於 Workshop 暴露了 MCP Server,Claude Code 可以直接讀取 trace 內容,根據這些 trace 撰寫 eval 測試,把測試執行起來,觀察失敗的斷言,回頭修改 Agent 的程式碼,再重新執行——直到所有測試透過。

Raindrop 稱這個迴圈為「自我修復 eval 迴圈」。整個過程在本地閉環,Claude Code 讀 trace、寫 eval、看失敗、改程式、重跑,不需要開發者手動介入每一個步驟。

Workshop 還支援 Replay 功能:把線上環境的 trace 拉回本地,對著真實程式碼重新執行,做回歸測試。這對「生產環境出錯但本地重現不了」的情況特別有用,直接拿真實 trace 跑,省去構造復現場景的時間。

📍相關報導📍

Anthropic 與 Gates Foundation 達成 2 億美元合作:推動全球 AI 數位平權,助攻偏鄉醫療、教育與農業