不聲不響放出大招!美團近期在毫無官方宣傳、也未開源的極度低調狀態下,悄悄上線了新一代大模型「LongCat-2.0-Preview」。這款專為 AI Agent 打造的巨獸,不僅具備百萬上下文處理能力,更被業內爆料是全程動用高達 5 到 6 萬張「國產算力卡」訓練而成,創下國產最大規模算力訓練的歷史紀錄。目前該模型僅開放邀請測試,每日提供千萬免費 Token 額度。

(前情提要:摩根大通:AI 不是搶飯碗,是產能倍增器,需求擴張才是就業關鍵)

(背景補充:收藏卡交易上鏈有搞頭?Renaiss平台5個月交易破千萬鎂,二級市場轉起來了)

在全球 AI 軍備競賽白熱化之際,中國科技巨頭美團(Meituan)選擇以一種極度低調卻震撼的方式秀出肌肉。

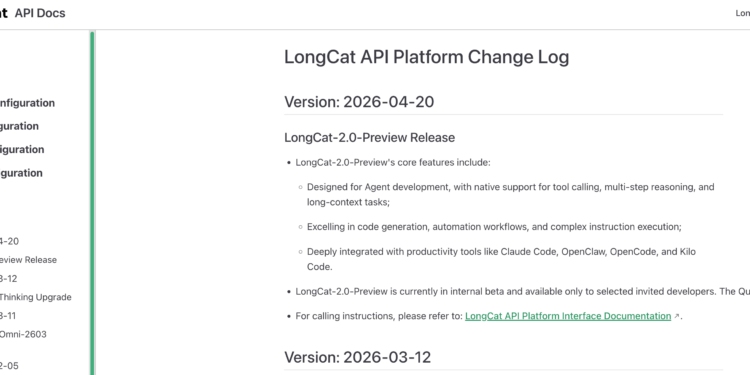

近期,多位業內人士與開發者發現,美團的 LongCat API 平台悄悄上線了一款名為 LongCat-2.0-Preview 的新模型。更新日誌顯示日期為 4 月 20 日,但令人意外的是,美團至今未發布任何官方新聞稿,也沒有釋出技術報告或開源程式碼,目前僅透過 API 形式提供邀請測試。

反常的低調:未開源、零宣傳

回顧美團 LongCat 系列的發展史,從 2025 年開始活躍的 Flash-Chat(560B MoE)、Flash-Thinking 到 Omni 等版本,每次發布必定伴隨著詳盡的官方部落格、技術白皮書,並同步於 Hugging Face 和 GitHub 上開源。然而,這次迎接跨世代的 2.0 版本,美團卻選擇了「悶聲發大財」的策略。

根據官方簡短的更新日誌,LongCat-2.0-Preview 幾乎是為生產力而生,明確列出了三大核心能力:

- 面向 Agent 開發:原生支援工具調用(Tool Calling)、多步推理與長上下文任務。

- 自動化生產力:極度擅長程式碼生成、自動化工作流與複雜指令的執行。

- 深度生態整合:已深度集成 Claude Code、OpenClaw、OpenCode 以及 Kilo Code 等前沿工具。

對標 DeepSeek V4,萬億參數與百萬上下文

隨著 4 月 24 日更多媒體與知情人士的爆料,這款神秘模型的真實底細終於浮出水面。

據悉,LongCat-2.0-Preview 採用了混合專家(MoE)架構,總參數一舉突破了萬億級別,其參數規模與激活參數數量,基本與同日震撼發布的 DeepSeek V4 處於同一量級。同時,該模型支援高達 1M(百萬)上下文窗口,單次可吞吐數百萬字的巨量輸入,整體能力直指 GPT-5.5 等國際最前沿大模型。

國產算力的歷史性里程碑

相較於模型本身的龐大參數,更具戰略意義的是其背後的算力基礎。

知情人士透露,LongCat-2.0-Preview 的訓練與推理,「全程」基於中國國產算力叢集完成。據稱,美團為此動用了高達 5 到 6 萬張國產加速卡。這不僅徹底擺脫了對 NVIDIA 等海外高端 GPU 的依賴,更一舉創下了迄今為止在國產算力上完成的「最大規模大模型訓練紀錄」。

目前,該模型已在官網(longcat.ai)開放邀請測試,並豪氣地提供每日 1,000 萬的免費 Token 額度供開發者嘗鮮。