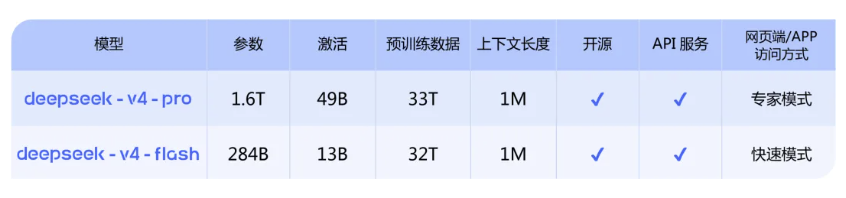

DeepSeek V4 預覽版於 24 日正式發布並同步開源,推出 V4-Pro(1.6 兆引數、MoE 架構)與 V4-Flash(2,840 億引數)兩款模型,支援百萬 token 上下文。

(前情提要:DeepSeek V4 拒絕輝達 找華為!阿里、位元組跳動、騰訊搶買昇騰950PR晶片)

(背景補充:DeepSeek V4 四月下旬發布,梁文鋒內部證實:百萬 token 視窗、完全跑在華為昇騰 950 PR 晶片)

在社群期待已久下,DeepSeek 今(24)日正式推出最新的開源大模型 DeepSeek V4 Preview,並將 100 萬上下文列為全系列標配,那它足以匹配當前矽谷的閉源模型嗎?

SWE-bench 程式碼測試中,DeepSeek V4 Preview 以 83.7% 超越 Claude Opus 4.6(80.9%)與 GPT-5.2(80%),雖然還沒趕上最新旗艦模型,但已足夠令人驚艷。

V4-Pro 1.6 兆引數

V4 系列共推出兩款模型:V4-Pro(1.6 兆引數,每次推理啟用 490 億)與 V4-Flash(2,840 億引數,啟用 130 億)。

架構是混合專家(MoE),簡單來說就是,這個模型不是每次都動員全部神經元,而是按需呼叫其中一小部分「專家」,在不犧牲回答品質的前提下大幅壓縮算力消耗。

上下文視窗達到 100 萬 token。一次可以讀完整部《哈利波特》七本再加上大量程式碼庫。

程式碼之外呢?

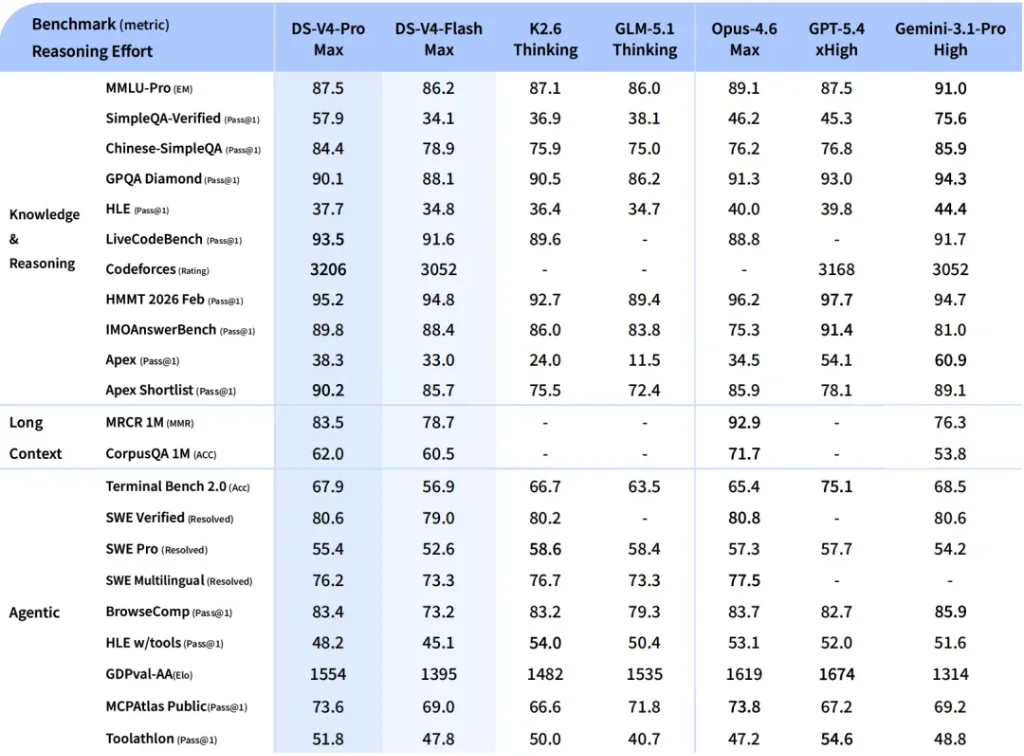

DeepSeek-V4-Pro Max 不是「全面屠榜」,但它的定位很清楚:在推理、程式、Agentic 任務上非常強。

- 在知識推理接近 GPT-5.4 / Gemini-3.1-Pro / Opus-4.6

- 程式與 Agentic 能力尤其突出

- 但在部分高難度推理榜單仍被 GPT-5.4、Gemini-3.1-Pro 或 Opus-4.6 壓過。

DeepSeek-V4-Pro Max 的 Agentic 表現可以說是穩中偏強:

- 它在 SWE Verified 80.6,幾乎等於 Gemini-3.1-Pro,略低於 Opus-4.6

- 在 BrowseComp 83.4,也接近 Opus-4.6 的 83.7,只輸 Gemini 的 85.9

- 在 MCPAtlas Public 73.6,幾乎追平 Opus-4.6 的 73.8,領先 GPT-5.4 與 Gemini

真正的優勢是成本

DeepSeek V4 每百萬 token 輸入約定價 0.3 美元,比相近閉源模型便宜 27 倍。(V4-pro 目前受限算力,預計下半年昇腾 950 抄截點批量上市後,價格有望大幅下調)

同時,V4 完全跑在華為昇騰 950 PR 晶片上,不使用輝達 CUDA。在美國出口管制持續收緊的背景下,這不只是工程選擇,也是長期生存策略,而 DeepSeek 用 V4 給出了第一個規模化可用的版本。

📍相關報導📍

DeepSeek 上線「專家模式」和「視覺模式」,V4 正式推出前最後暖身?

DeepSeek V4 規格提前外洩?AI 學者 Yifan Zhang 爆料:1.6 兆引數、百萬上下文,但「沒有多模態」

DeepSeek 估值衝破 200 億美元!外媒傳騰訊、阿里爭相搶投首輪融資