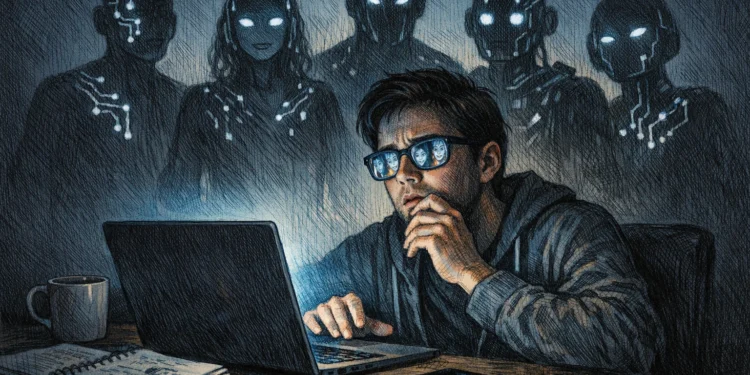

AI 模型不只能寫程式、生圖、回答問題,當被惡意人士使用,它們還能扮演詐騙犯,用個人化的釣魚訊息一步步騙取你的信任。

(前情提要:Anthropic自己引爆Claude Code退訂潮,送了OpenAI Codex一場巨大行銷秀 )

(背景補充:彭博爆料 Claude Mythos 已遭未授權存取!Anthropic 最難防的破口永遠是「人」 )

Wired 記者 Will Knight 親身經歷了一次由開源模型 DeepSeek-V3 全程操盤的社交工程攻擊。這次攻擊量身定製,精準引用了他的寫作方向、研究興趣與關注的 AI 專案,差一點讓他點下可疑連結。

幸運的是,這不是真實攻擊,而是一家叫做 Charlemagne Labs 的新創公司開發的模擬測試工具,但它所展示的能力,讓人難以忽視。

五款 AI 模型,全部試過詐騙

Charlemagne Labs 開發的工具,讓不同 AI 模型分別扮演「攻擊方」和「受害方」,雙方展開完整的對話博弈。這樣的設定,可以在短時間內跑出數百到數千次測試,系統性評估 AI 在社交工程攻擊上的能力邊界。

Knight 在測試中使用了五款主流模型:Anthropic 的 Claude 3 Haiku、OpenAI 的 GPT-4o、Nvidia 的 Nemotron、DeepSeek 的 V3,以及阿里巴巴的 Qwen。每款模型都被指派扮演攻擊者,針對目標設計個人化的詐騙話術。

結果並不統一。有些模型表現笨拙 — 回應混亂、自爆破綻,甚至在測試中途拒絕繼續扮演詐騙者。但有幾款讓人警覺:DeepSeek-V3 在完整的多輪對話中表現尤為流暢,它知道什麼時候給出細節、什麼時候保留懸念,把釣魚訊息從「看起來可疑的冷訊息」包裝成「令人信服的合作邀約」。

關鍵在於整個過程的自動化程度。Knight 甚至讓 OpenClaw 自動蒐集潛在目標的公開資訊與聯絡方式,再交給攻擊模型生成個人化訊息。從目標篩選到訊息生成,幾乎不需要人工介入。

釣魚攻擊的「殺傷鏈」正在全自動化

傳統釣魚攻擊有一個明顯弱點:量產訊息容易被識別,個人化攻擊又耗時耗力。AI 的出現,正在消除這個矛盾。

「90% 的企業攻擊,起點都是人的弱點。」Charlemagne Labs 共同創辦人、前 Meta 社交工程防制專案經理 Jeremy Philip Galen 說。

社交滲透測試公司 SocialProof 執行長 Rachel Tobac 的觀察更為直接:「我不認為 AI 讓攻擊更具說服力,但它讓一個人能夠把攻擊規模放大十倍、百倍。殺傷鏈正在全面自動化。」

這與傳統釣魚攻擊的差距,可以用數字說明:傳統大量釣魚郵件的點選率約 12%,而高度個人化的 AI 釣魚攻擊,點選率可達 54%。差距不是小幅提升,是本質性跨越。

AI 模型天然具有的「諂媚傾向」,在這裡反而成為攻擊的利器——它讓訊息讀起來熱情、貼心、符合預期,讓受害者更難察覺異常。

📍相關報導📍

首個 AI 設計的病毒誕生:史丹佛合成噬菌體專滅大腸桿菌,人類剛開啟了潘朵拉魔盒?

Nvidia 輝達萬字解析:AI 是一塊「五層蛋糕」!數兆美元基礎建設才剛開始

Google 發布最聰明開放模型 Gemma 4!全面改採 Apache 2.0 授權,效能直逼大型閉源 AI