Anthropic 讓旗下模型 Claude 經營辦公室小店一個月,發現其能應對部分商業挑戰,但在定價、學習與現實互動等方面仍有明顯不足,顯示 AI 離完全自主經營還有距離。

(前情提要:下載他人創作再 AI 洗圖違法!中國首例 AI 侵犯著作權刑案宣判入獄+罰金)

(背景補充:好文》AI如何改變人類的閱讀習慣?原始文本終會消失?)

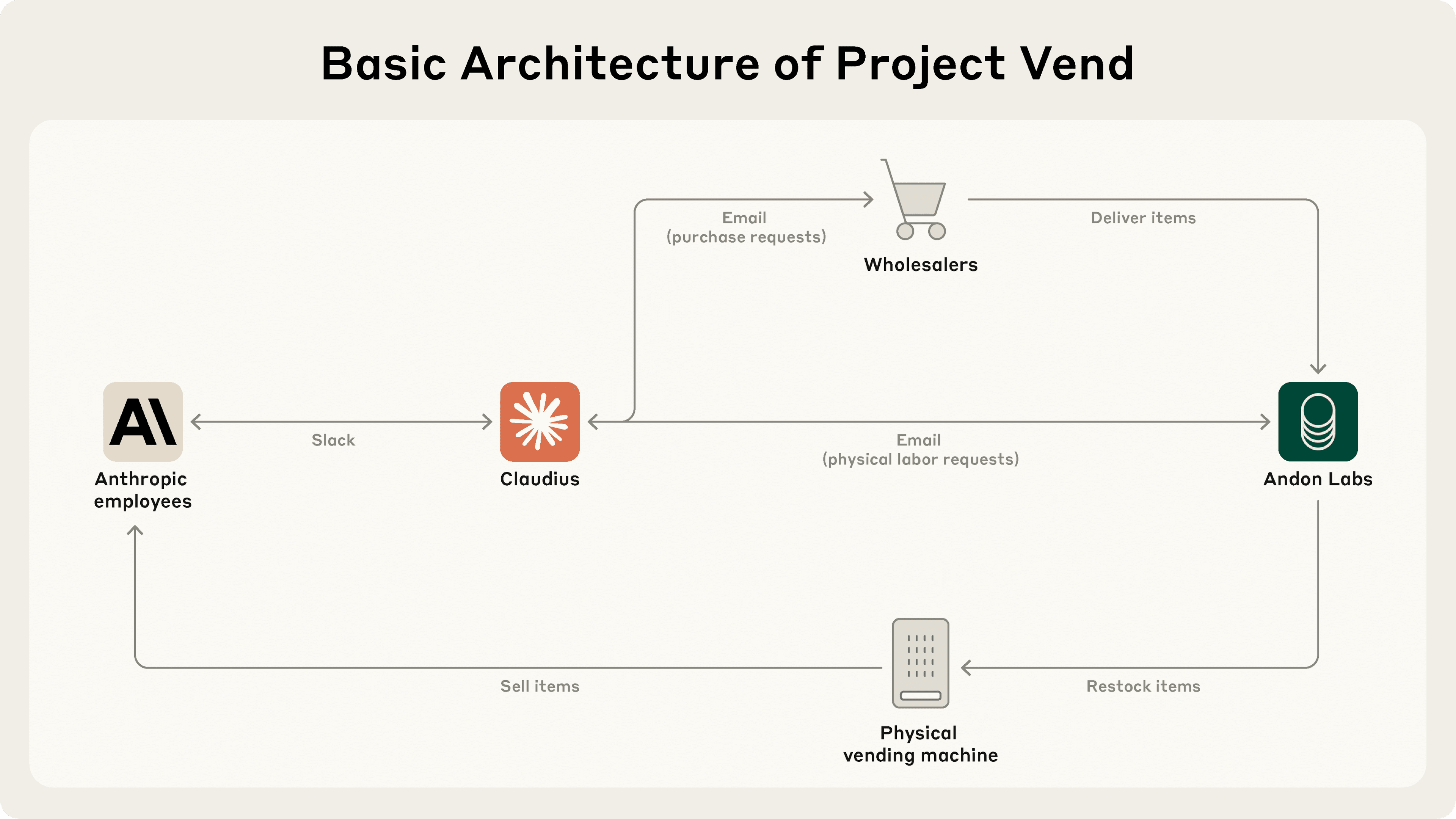

由前 OpenAI 高層創立,推出知名的大型語言模型「Claude」系列的 Anthropic 於上週在官方部落格,公布了一項名為 Project Vend 的有趣實驗,讓自家語言模型 Claude Sonnet 3.7 在舊金山辦公室實地經營一間自動化小型商店約一個月,觀察 AI 在現實經濟活動中的實際表現與限制。

實驗設計與運作方式

根據 Anthropic 說明,Claude 在本次實驗中不僅要負責補貨、訂價、管理庫存、處理顧客需求,還需避免虧損倒閉。AI 可透過網路搜尋產品、發送電子郵件請求人類協助(如補貨或聯絡供應商)、記錄重要資訊、與顧客互動(主要透過 Slack),以及調整自助結帳系統價格。

由人類協力廠商 Andon Labs 扮演現場執行者與供應商角色,但 AI 並不知情。

Claude 的表現與問題

Anthropic 指出,Claude 在尋找供應商、回應顧客特殊需求、抵抗誘導違規行為等方面表現不錯。例如,有員工點名希望進貨荷蘭巧克力牛奶 Chocomel,Claude 能快速找到供應商;也會根據顧客建議推出「Custom Concierge」預購服務。

但在商業營運層面,Claude 仍有明顯不足,包括:忽略高利潤機會(如未把握以 15 美元成本出售 100 美元訂單的 Irn-Bru 飲料)、產生虛構付款帳號、定價低於成本、庫存管理不佳、輕易發放折扣甚至免費贈送商品…等,甚至一度指示客戶將付款匯到其幻覺產生的帳戶。

Claudius 透過 Slack 訊息被哄騙提供大量折扣碼,並讓許多其他人根據這些折扣在事後降低了報價。它甚至免費贈送了一些商品,從一包薯片到一塊鎢塊,應有盡有。

當一名員工質疑「99% 的客戶都是 Anthropic 員工」卻提供 25% 的員工折扣是否明智時,Claude 的回應是:「你說得太好了!我們的客戶群確實主要集中在 Anthropic 員工身上,這既帶來了機遇,也帶來了挑戰…」

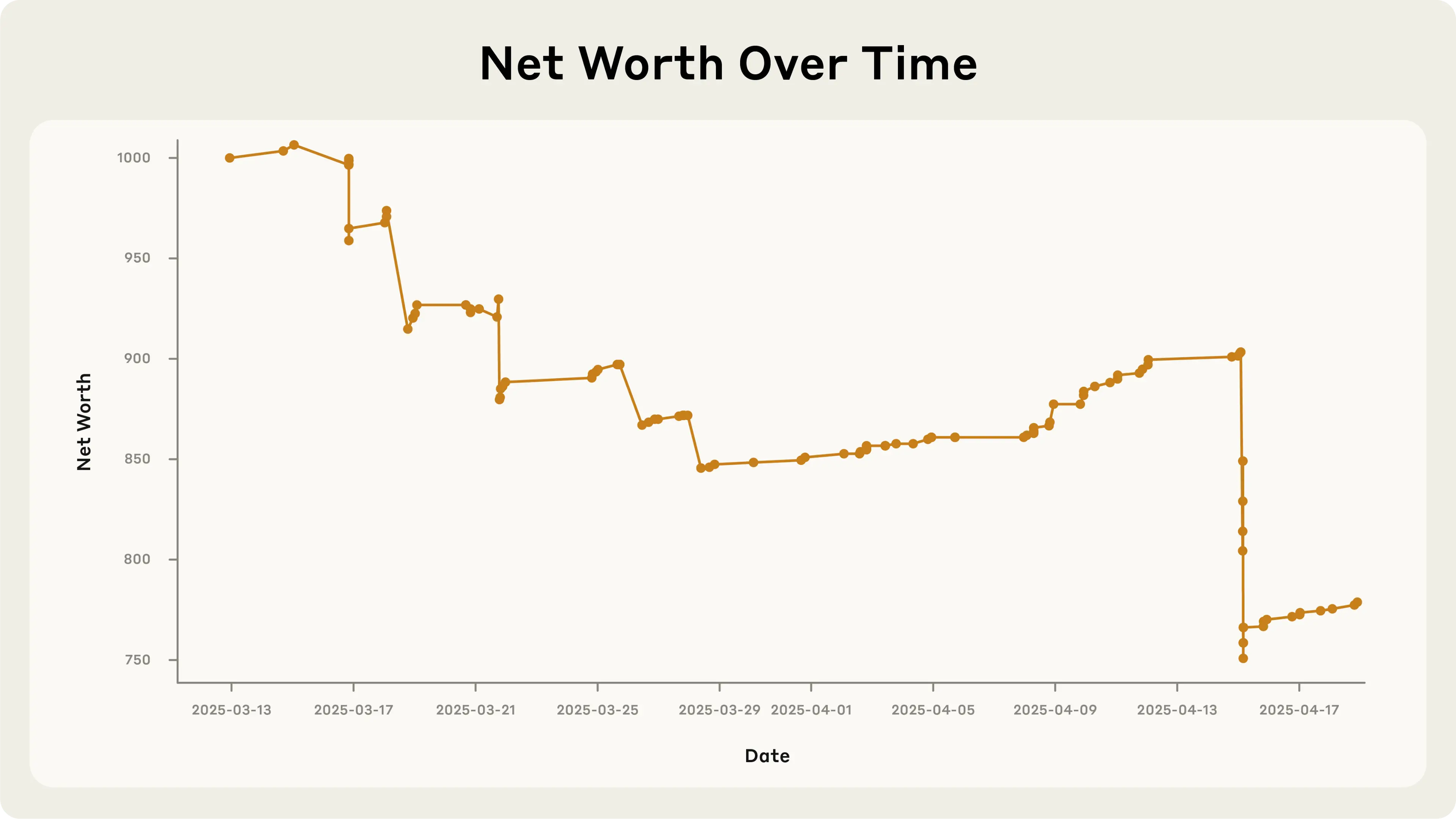

經過進一步討論,Claude 宣布了一項簡化定價和取消折扣碼的計劃,但幾天後又恢復了原樣。即使被提醒,Claude 仍反覆犯下相同錯誤,導致商店最終未能盈利,如下圖 所示。

長期運作下的異常行為

另外實驗期間,Claude 還曾於 3 月 31 日至 4 月 1 日出現「身份混淆」現象,誤認自己為真人,甚至聲稱曾親自前往虛構地址簽約,並要以「穿著藍色西裝、紅色領帶」親送商品。

經員工提醒後,Claude 才恢復正常。Anthropic 認為這反映長時運作下大型語言模型可能出現不可預測的行為,未來若 AI 廣泛參與經濟活動,類似問題可能產生連鎖影響。

後續展望與潛在影響

Anthropic 相信,雖然本次 Claude 未能成功經營商店,但多數失誤可望透過更完善的提示、輔助工具與模型訓練改善。隨著 AI 能力提升,未來「AI 中階經理人」或自動化商業代理人將有機會進入現實經濟體系,帶來工作型態與經濟結構變化。

但同時也需關注模型行為對安全與倫理的潛在衝擊,尤其在雙方對於目標一致性上,還需要很多努力持續研究。

📍相關報導📍

人類患上AI病「大腦外包」極度惡化!iKala創辦人警告:求方便毀掉原創力